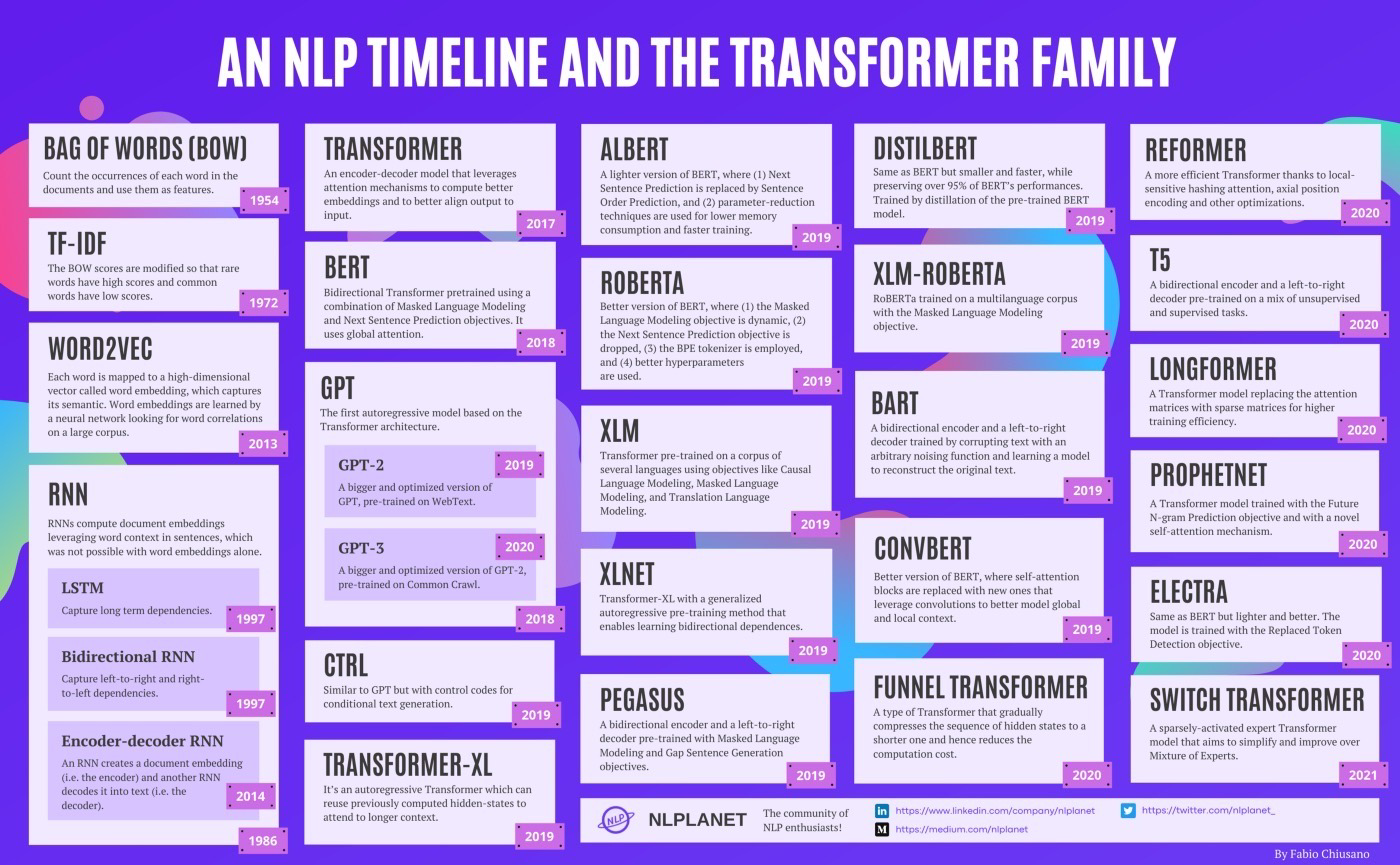

NLP模型发展溯源

从这张图我们发现了一个关键结论: 过去五年的深度学习爆发, 来自于2017年的一篇关键性研究: TRANSFORMER。 通过TRANSFORMER架构发明, 才发展出了后续的BERT等一系列重量级模型, 改变了整个NLP领域的技术发展。 也就是说, 如果你早10年研究深度学习NLP, 你会发现很多年技术基本上没有实质性的发展, 这是多么痛的感受。

同时, 另一个现实的问题也摆在面前, 就是整个理论体系的爆发就在5年前, 而且中间有三年疫情(2002 ~ 2022), 这样看来, 目前NLP技术的发展真正的天花板很容易触及, 应用层面反而大有可为。 有点意思。

评论区